分類問題というのは、

・これはスパムか?

・この画像は犬か猫か?

・この患者は病気か?

のように、「どっち?」を決める問題です。

でも、大事なのは、当たったかどうかだけじゃありません。

たとえば病気の検査で、AIが「陽性」と言ったとします。

でも実は陰性だった……。

これはただの「間違い」ではないですよね。

逆に、本当は病気なのに「大丈夫」と言ってしまうのも、ぜんぜん違う重みの間違いです。

分類問題の評価とは、どんな種類の間違いをしたのか、どんな間違いを減らしたいのか、を見ることなのです。

混同行列

分類モデルは、「正しいか、間違っているか」だけでは測れません。

なぜなら、

・何を正解としたか

・どんな間違いをしたか

によって、意味が大きく変わるからです。

そこで使うのが 混同行列です。

混同行列は、予測と実際の結果を、4つのパターンに分けて整理する表です。

1 正しく見つけた

2 正しく除外した

3 間違って疑った

4 見逃した

「ちゃんと当てたよ」「ここは勘違いした」「ここは見逃した」……その内訳を全部見せてくれます。

予測の内訳を見える化する表、とも言えるでしょう。

予測の内訳を分解する(4つの基本パターン)

混同行列では、予測を次の4つに分けます。

◆真陽性(TP:True Positive)

実際に陽性で、予測も陽性。

→ 正しく「ある」と当てた。

◆真陰性(TN:True Negative)

実際に陰性で、予測も陰性。

→ 正しく「ない」と当てた。

◆偽陽性(FP:False Positive)

実際は陰性なのに、陽性と予測。

→ 「ある」と誤って判断(誤検出)。

◆偽陰性(FN:False Negative)

実際は陽性なのに、陰性と予測。

→ 「ない」と見逃した。

簡単にまとめてみましょう。

真陽性 → 当てた

真陰性 → 当てた

偽陽性 → 勘違いした

偽陰性 → 見逃した

混同行列は、「どんな間違いをしたのか」を可視化してくれます。

精度指標

混同行列ができたら、そこから「どれくらい良いモデルか」を数値で表すことができます。

ここでは代表的な指標を見ていきます。

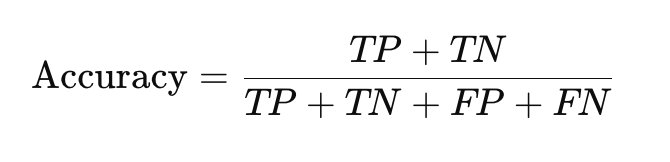

正解率(Accuracy)

全体のうち、どれだけ正しく予測できたかを表す指標です。

つまり、

正しく当てた数 ÷ 全体の数

とても分かりやすい指標ですが、データが偏っている場合(例:ほとんど陰性)には、高く見えてしまうことがあります。

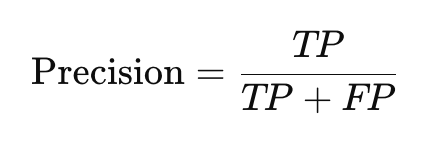

適合率(Precision)

陽性と予測したもののうち、本当に陽性だった割合。

「陽性」と言ったときの信頼度になります。

偽陽性(FP)をどれだけ減らせているかを見る指標です。

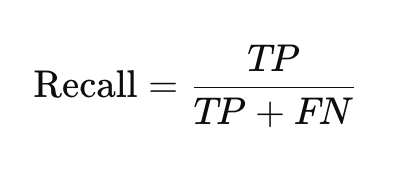

再現率(Recall)

本当に陽性だったもののうち、どれだけ正しく見つけられたか。

見逃しの少なさ。

偽陰性(FN)をどれだけ減らせるかを見る指標です。

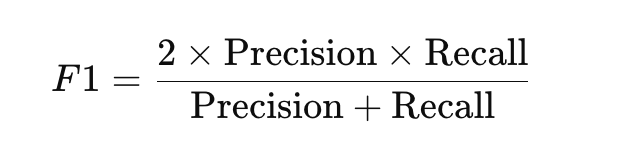

F値(F1スコア)

適合率と再現率のバランスを取った指標。

どちらか一方だけ高くても意味がありません。

ために、両方をバランスよく評価します。

簡単にまとめてみましょう。

正解率 → 全体でどれだけ当てたか

適合率 → 当てたと言ったものの正確さ

再現率 → いかに見逃さないか

F値 → バランス型評価

ROC曲線とAUC

分類モデルは、多くの場合「確率」を出しています。

たとえば、

・これは陽性である確率 0.82

・これは 0.37

でも実際に「陽性/陰性」を決めるには、しきい値(threshold)を決めなければなりません。

たとえば、

・0.5以上なら陽性

・0.7以上なら陽性

このしきい値を動かすと、

・適合率

・再現率

も変わります。

そこで登場するのが ROC曲線。

これは、「どこからを陽性にする?」という線引きを動かしたときの変化を見るものです。

たとえば、

・すこしでも怪しかったら陽性にする。→ 見逃しは減る。でも誤検出は増える。

・厳しく判定する。→ 誤検出は減る。でも見逃しは増える。

ROC曲線は、その揺れを全部描くグラフです。

そしてAUCは、その地図の総合点です。

しきい値をどう決めても、ちゃんと見分ける力があるかどうかを測ります。

ROC曲線

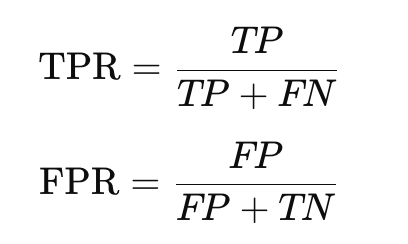

ROC曲線は、

・横軸:偽陽性率(FPR)

・縦軸:真陽性率(TPR=再現率)

をとって、しきい値を動かしたときの変化を描いたグラフです。

つまり、どれだけ正しく見つけられたか、どれだけ誤って陽性にしてしまったか、のバランスを見ています。

ROC曲線は、「強気に攻めたら、どれくらい誤爆するか」を描いた曲線とでも言いましょうか。

左上に近いほど、理想的なモデルです。

AUC

AUC(Area Under the Curve)は、ROC曲線の下の面積を、数値で表したもの。

値は 0〜1 の間をとります。

1 に近い → とても良いモデル

0.5 → ランダム予測と同じ

0 未満(反転) → 予測が逆

AUCは、「しきい値に依存しない評価」というのが大きな特徴です。

まとめると、

・ROC曲線 → しきい値を動かしたときの性能変化

・AUC → その総合評価

となります。

正解率だけでは、

・データが偏っている

・しきい値の選び方で評価が変わる

といった問題がありました。

ROCとAUCは、モデルそのものの「識別能力」を測る指標です。